Nuevos libros de texto: ¿educación o ideología?

Primer grado "nuestros saberes" es el libro clave que concentra todo el conocimiento de las materia de antes se tenían... Para el primer grado, este libro contiene sugerencias de lecturas, cuentos, poesía y algunos juegos. y hay tres libros de actividades para fortalecer el aprendizaje. un libro de proyectos de aula, otro de proyectos escolares y el de proyectos comunitarios, para realizar actividades pensando en lo que sucede en nuestra casa, colonia, barrio, ciudad...

Ricardo fuentes, director de enlaces de la secretaría de finanzas de la Ciudad de México dijo para Meganoticias que: "Se trata de no anteponer el interés individual, sino el interés común, de todas y todos, se trata de aprender a través del interés de la colectividad, eso no es comunismo, que nos nos quieran confundir".

El libro nuestros saberes reduce los contenidos de matemáticas y español. no incluye por ejemplo sumas ni restas ni tampoco ortografía o gramática. aunque usa ejemplos de cómo calcular la cantidad de cucharadas de azúcar en diferentes alimentos para entender sobre proporciones. el libro dedica 20 de sus 250 páginas a las matemáticas. (página 101) este libro incluye contenidos que ayudan a niñas y niños a conocerse, respetarse y reconocer la diversidad. no menciona al bullying como tal, pero da ejemplos de la importancia de no burlarse ni agredir a nadie...

Los libros incluyen conceptos que podrían ser de difícil comprensión para niñas y niños. como la palabra "resignificación" que se refiere a un cambio en nuestra manera de pensar, por citar ejemplo.

Al respecto, Irma Villalpando, doctora en pedagogía dijo que los niños no necesitan a los 6 años hacer una construcción sociocrítica, una comprensión doctrinaria de política del contexto, del entorno ¿Qué necesita los niños, aprender a leer, aprender pensamiento lógico matemático, tener buena comprensión de lectura 10.56 > también tienen algunos errores como hablar de "consumir agua bebestible", en vez de sólo decir "toma agua", cuando se refieren a la alimentación saludable.

Otro detalle que destaca y que puede generar numerosas interpretaciones, es la forma cómo se explican las actividades a realizar. frases como "reunirse en plenaria", dialogar en "comunidad de aula" o escribir "los acuerdos asamblearios" a los que llegaron niñas y niños de primer grado.

Con información de Andrés Solís y Leticia alcántara, Meganoticias

Noticias Similares

Noticias Destacadas

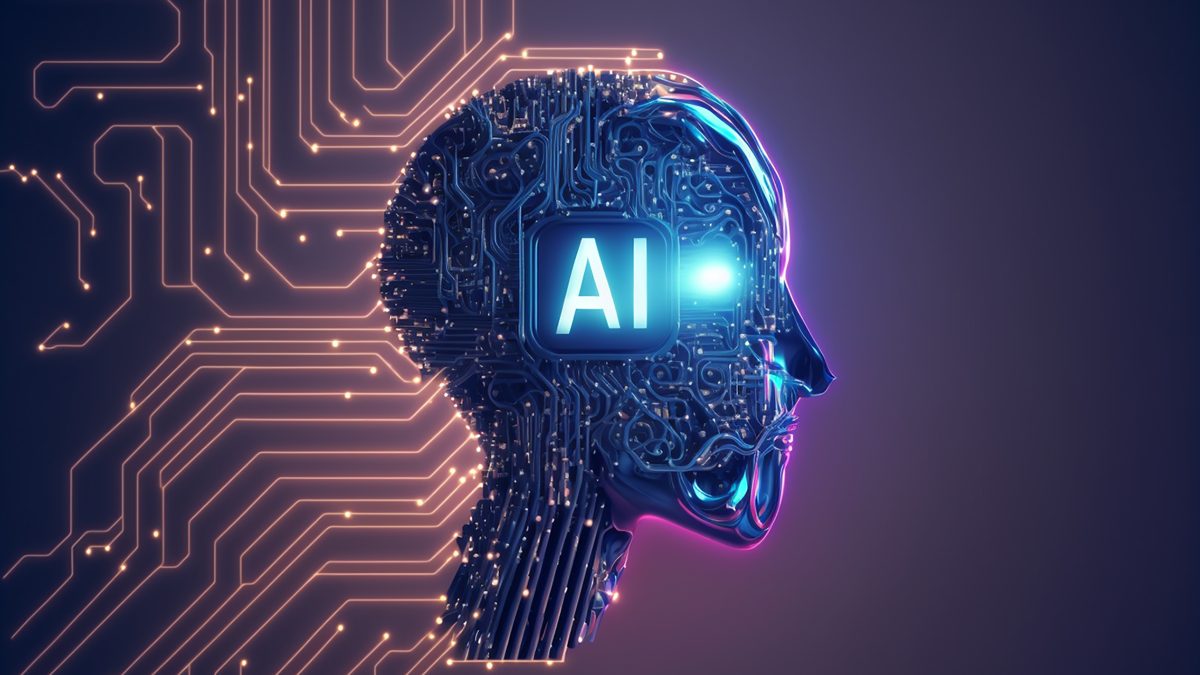

Los abusos de la inteligencia artificial

La inteligencia artificial (IA) ha emergido como una de las tecnologías más transformadoras de los últimos tiempos, con el potencial de mejorar innumerables aspectos de nuestra vida diaria, desde la medicina hasta la educación y el transporte.

Empresas y gobiernos de todo el mundo están invirtiendo grandes recursos para aprovechar sus capacidades, confiando en que la automatización y el análisis de datos podrán hacer nuestras vidas más eficientes y conectadas.

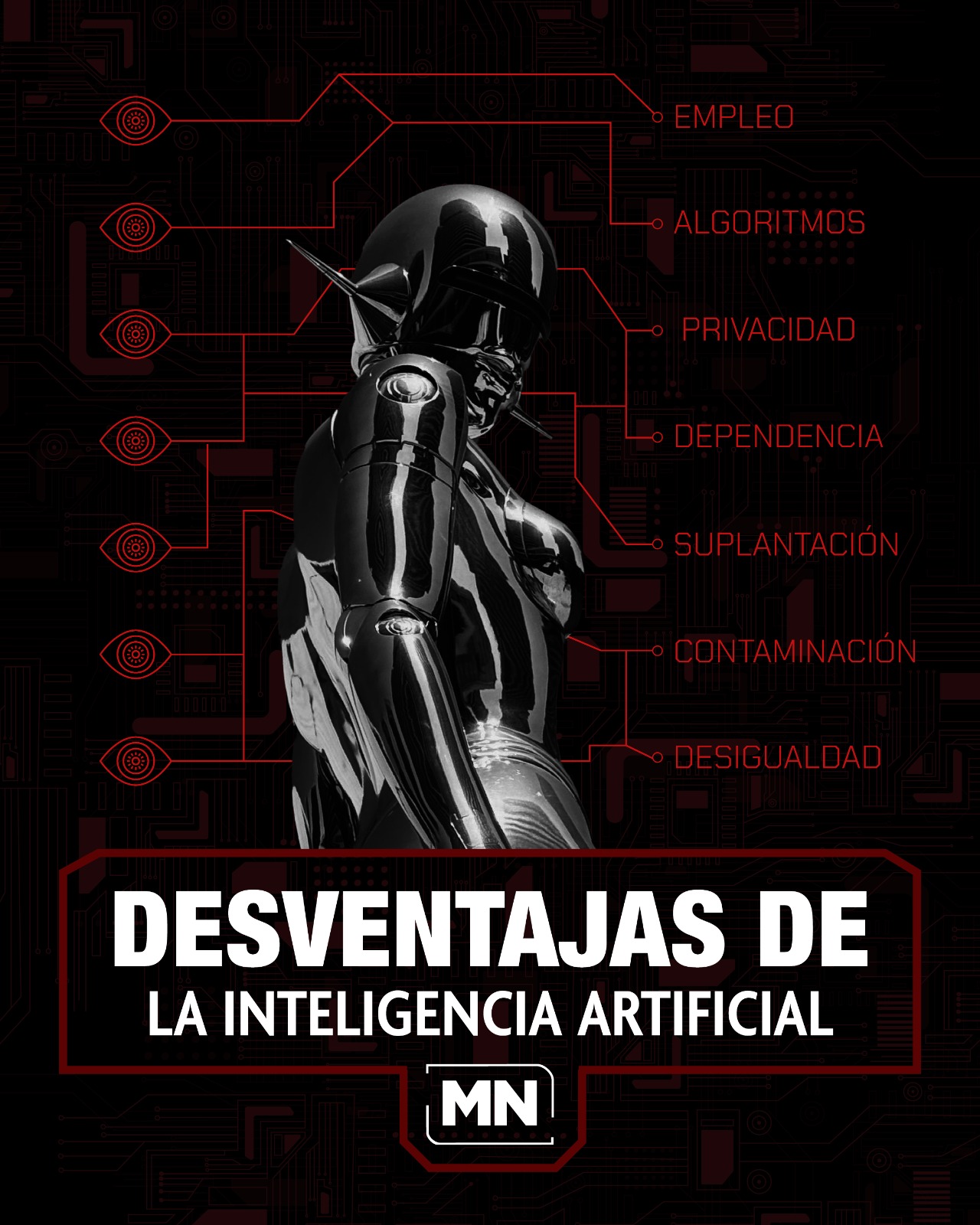

Sin embargo, la IA, a pesar de sus indudables ventajas, también plantea una serie de riesgos y desventajas que no pueden ser ignorados. Estos problemas se extienden a diversas áreas, incluidas la ética, la privacidad, el empleo y la educación, y requieren una reflexión profunda sobre cómo debemos gestionar su integración en nuestra sociedad.

Si bien la IA puede hacer tareas repetitivas con precisión y agilidad, también puede afectar negativamente a sectores laborales completos, crear desigualdades sociales, poner en riesgo nuestra privacidad y, en muchos casos, tomar decisiones sin la comprensión necesaria del contexto humano.

La falta de regulación, los posibles sesgos algorítmicos y los dilemas éticos que surgen al confiar en sistemas autónomos son solo algunos de los aspectos problemáticos. En este contexto, es vital evaluar de manera crítica los peligros asociados con el uso de la IA y cómo estos afectan la vida diaria de las personas, especialmente en áreas sensibles como la educación y el trabajo.

Para ello, es importante escuchar las voces de expertos que, a través de investigaciones y experiencias, nos ofrecen una visión clara de los peligros de esta tecnología.

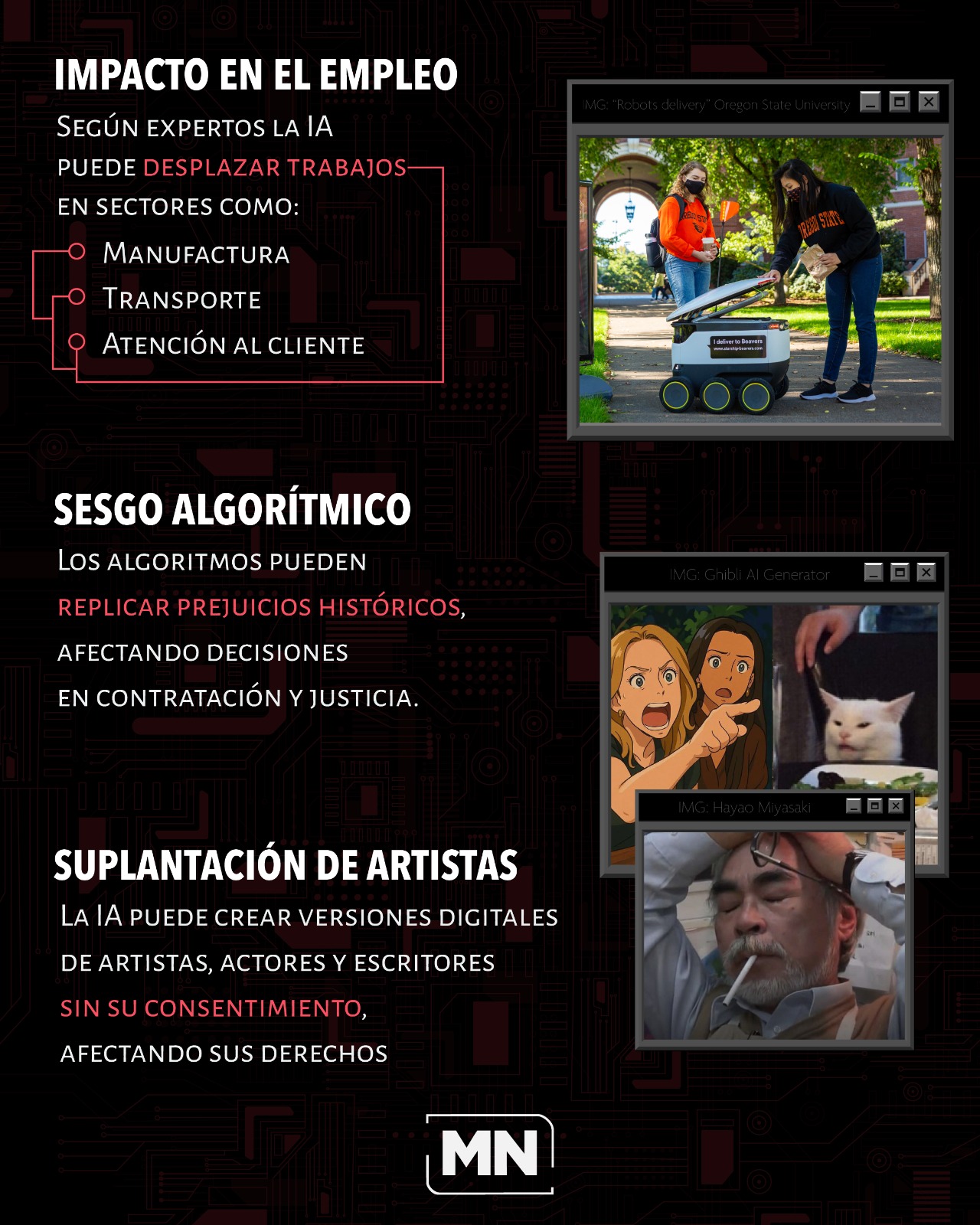

El impacto en el empleo: Desplazamiento y adaptación

Uno de los mayores temores relacionados con la inteligencia artificial es su impacto en el empleo. La automatización de procesos, que se ha acelerado en los últimos años, ha llevado a la pérdida de empleos en diversas industrias.

Los trabajos que antes dependían de habilidades manuales y repetitivas ahora son ejecutados por máquinas inteligentes, lo que genera una gran preocupación sobre el futuro del trabajo humano.

Según un artículo de ISDI México, uno de los efectos más inmediatos de la IA en el empleo es el desplazamiento de trabajadores en sectores como la manufactura, el transporte y la atención al cliente.

Tareas que antes requerían la intervención humana ahora son realizadas por sistemas automatizados, lo que ha llevado a que muchas empresas opten por la IA para reducir costos y aumentar la eficiencia.

Tulio Daza, candidato a Doctor en Economía y Empresa por la Universidad de Navarra y profesor de tiempo completo en la Universidad de Guadalajara, menciona cómo, "a pesar de las predicciones que prometían la eliminación de ciertas profesiones, como la de los radiológos o los conductores de vehículos, la realidad ha sido diferente".

Comenta que "la IA no ha reemplazado completamente a los radiólogos, sino que ha mejorado la precisión en los diagnósticos médicos, ayudando en la toma de decisiones, pero no sustituyendo al profesional humano. De manera similar, los vehículos autónomos, aunque ya operan en algunas ciudades, aún enfrentan obstáculos tecnológicos y legales que impiden una adopción generalizada".

"El problema radica en que la IA puede mejorar la eficiencia, pero también puede generar una escasez de empleos en sectores tradicionales, lo que obliga a los trabajadores a adaptarse a nuevos roles y adquirir habilidades en áreas que aún no están completamente desarrolladas".

Por ejemplo, medios como BuzzFeed News despidieron personal editorial tras adoptar herramientas de IA para generar contenido automatizado. Aunque prometieron supervisión humana, muchos redactores fueron reemplazados por algoritmos capaces de escribir notas básicas o resúmenes. Este fenómeno ha encendido las alarmas en el gremio periodístico, que enfrenta una transformación radical ante la llegada de estas tecnologías.

A pesar de los beneficios que puede traer en términos de eficiencia y reducción de costos, la implementación acelerada de la inteligencia artificial en entornos laborales plantea serias preguntas sobre el futuro del empleo. Las industrias enfrentan el reto de adaptarse sin deshumanizar los procesos, y los trabajadores necesitan herramientas y políticas que les permitan reconvertirse.

Sesgo algorítmico y la discriminación inherente

Otro de los peligros más graves de la inteligencia artificial es el sesgo algorítmico, que puede tener efectos devastadores en sectores como el empleo, la justicia y la salud.

Los algoritmos de IA funcionan analizando grandes volúmenes de datos para identificar patrones y tomar decisiones basadas en esos datos. Sin embargo, si los datos utilizados para entrenar estos algoritmos son sesgados o reflejan desigualdades históricas, los sistemas de IA pueden perpetuar estos prejuicios.

El artículo de ISDI México destaca que este tipo de sesgo puede manifestarse de manera particularmente preocupante en el ámbito de la contratación laboral. Por ejemplo, si los datos históricos utilizados por un algoritmo reflejan la discriminación de género o raza en las contrataciones anteriores, el sistema de IA podría replicar estos patrones y favorecer a candidatos de un grupo particular, sin una consideración justa o equitativa.

Este tipo de discriminación automática pone en evidencia la necesidad de realizar auditorías constantes y rigurosas a los algoritmos para garantizar que no se perpetúen prejuicios sociales.

Además, la falta de empatía de la IA es otro de los aspectos críticos que mencionan los expertos. A diferencia de los seres humanos, los sistemas de IA no pueden interpretar las emociones o el contexto en el que se desarrollan las interacciones.

Un estudio de la Dra. Nomisha Kurian, de la Universidad de Cambridge, advierte que los chatbots de inteligencia artificial carecen de empatía, lo que representa un riesgo para los niños. Al tratarlos como si fueran humanos, los menores pueden confiarles información sensible sin recibir respuestas adecuadas, lo que podría generar consecuencias emocionales negativas.

La investigación señala que estos sistemas solo imitan el lenguaje sin comprenderlo realmente, lo que limita su capacidad para manejar emociones. Kurian propone un enfoque de diseño centrado en la seguridad infantil, con principios claros para proteger a los usuarios jóvenes y evitar interacciones dañinas.

Esto se vuelve especialmente relevante en campos como la atención al cliente, donde la capacidad de comprender las necesidades emocionales de las personas es fundamental. La IA, aunque eficiente, no posee la comprensión humana necesaria para generar empatía, lo que puede llevar a interacciones frías o insatisfactorias con los usuarios.

Privacidad y seguridad: Los riesgos de la recopilación de datos

El uso de la inteligencia artificial también plantea graves preocupaciones sobre la privacidad y la seguridad de los datos.

La mayoría de los sistemas de IA requieren una cantidad masiva de datos personales para funcionar de manera efectiva, lo que implica que, en muchos casos, estamos compartiendo información sensible sobre nuestras vidas, comportamientos y preferencias con empresas y plataformas. Si esta información no se maneja adecuadamente, puede dar lugar a violaciones de la privacidad, robo de identidad e incluso manipulación política.

En su estudio "A survey of AI Ethics in Business Literature", Tulio Daza señala que los datos personales almacenados en servidores de terceros están siempre en riesgo de ser hackeados o mal utilizados.

Dando un ejemplo claro, la filtración de datos de usuarios en la plataforma Ashley Madison en 2015, lo que expuso la información confidencial de millones de personas, causando daño a su reputación e incluso afectando vidas personales de manera irreversible.

Daza menciona otro caso ocurrido en 2016, donde la consultora británica Cambridge Analytica recopiló datos de 87 millones de usuarios de Facebook sin su consentimiento. Con esta información, construyeron perfiles psicológicos detallados y dirigieron publicidad personalizada para influir en la elección presidencial de EE. UU. y en el referéndum del Brexit en el Reino Unido. "Consideremos que esto fue antes de la llegada de la IA generativa con la capacidad de emular conversaciones, clonar voces y video" menciona.

Además, el uso de tecnologías como deepfake, que pueden suplantar la identidad de una persona mediante la manipulación de videos y voces, está comenzando a generar nuevas amenazas.

También menciona que en 2024, un caso de fraude mediante deepfake involucró a un director financiero suplantado durante una videollamada, lo que resultó en una pérdida de millones de dólares.

La preocupación por la privacidad también ha aumentado en América Latina, especialmente tras el auge de aplicaciones que requieren acceso a nuestras fotos y datos personales, como FaceApp y Voilá AI Artist.

El riesgo de que nuestras fotos sean utilizadas para entrenar algoritmos de IA sin nuestro consentimiento es algo que debe ser considerado seriamente, y expertos como María Isabel Manjarrez de Kaspersky advierten sobre la vulnerabilidad de nuestros datos personales almacenados en estos sistemas.

Los usuarios deben ser conscientes de cómo las plataformas utilizan sus fotos y asegurarse de leer las políticas de privacidad antes de compartir cualquier dato sensible.

Dependencia tecnológica y retos éticos

Uno de los riesgos menos discutidos, pero igualmente importante, es la dependencia tecnológica que estamos desarrollando hacia los sistemas de IA.

A medida que confiamos más en la IA para tareas cotidianas, desde la asistencia en la toma de decisiones hasta el manejo de información personal, corremos el riesgo de perder habilidades humanas esenciales.

Daza señala que "la excesiva dependencia de la IA podría hacer que las personas se vuelvan menos capaces de realizar ciertas tareas por sí mismas, lo que puede ser peligroso si los sistemas de IA fallan o no funcionan como se espera".

Además, comenta que los sistemas autónomos de IA enfrentan serios desafíos éticos. "¿Quién es responsable si un algoritmo toma una decisión incorrecta o dañina? Los sistemas de IA no tienen la capacidad de entender el contexto moral o ético de sus acciones, lo que plantea serias preguntas sobre la responsabilidad y el control humano en un mundo donde las máquinas toman decisiones cruciales".

Este es uno de los aspectos que muchos expertos en ética tecnológica consideran fundamental para el desarrollo de directrices claras y responsables en el uso de la IA.

Suplantación de artistas, actores, escritores, etc.

Uno de los aspectos más recientes y preocupantes del auge de la inteligencia artificial es la capacidad de esta tecnología para suplantar a artistas, actores y escritores, creando versiones virtuales de sus voces, rostros y estilos sin su consentimiento.

En cuanto al ámbito de la animación, los recientes avances de la inteligencia artificial también han comenzado a tocar a estudios emblemáticos como Studio Ghibli, conocido por su estilo artístico único e irrepetible. En este caso, la IA ha comenzado a experimentar con la creación de contenido visual similar al que Ghibli produce, lo que ha generado tanto fascinación como preocupación.

A través de herramientas como los deepfakes, los algoritmos de IA pueden generar imágenes, audios y videos que imitan perfectamente a cualquier figura pública, lo que plantea serios dilemas sobre los derechos de autor y la ética en la creación de contenido.

Recientemente, se han hecho virales casos de suplantación de la voz de actores populares para crear diálogos en películas que nunca fueron grabados por ellos. Esto no solo plantea una amenaza para la integridad del trabajo creativo, sino también para el propio sustento de los artistas, quienes podrían ver sus derechos vulnerados por la creación de contenido digital no autorizado.

Lo mismo ocurre con los escritores: hoy en día, los sistemas de IA pueden emular el estilo de autoría de escritores reconocidos, produciendo textos que parecen haber sido escritos por ellos, pero que en realidad son obras generadas por máquinas.

Esta situación ha llevado a un debate sobre los límites de la creatividad humana frente a la tecnología. Muchos en la industria del entretenimiento y la literatura están luchando por establecer marcos legales que protejan a los creadores de contenido, asegurando que las reproducciones digitales de sus obras no se realicen sin su autorización.

El Impacto Ambiental de la IA

El impacto ambiental de la Inteligencia Artificial (IA) es una preocupación creciente, especialmente debido al aumento de las emisiones de gases de efecto invernadero (GEI) generadas por su uso.

Según el Instituto para el Futuro de la Educación del Tecnológico de Monterrey, a pesar de que las emisiones de carbono no son exclusivas de un sector, la IA ha contribuido significativamente a la huella de carbono global.

En este contexto, la "huella de carbono" es la cantidad de GEI emitidos por las actividades humanas, que, en el caso de la IA, están vinculadas al alto consumo de electricidad de los centros de datos, necesarios para procesar y almacenar la información.

Estos centros, que manejan servidores y sistemas de refrigeración, contribuyen al aumento de las emisiones de CO2, y su crecimiento ha sido impresionante, pues en 2020, más de la mitad de los datos procesados en el mundo pasaron por centros de hiperescala, los más grandes y poderosos.

El alto consumo energético de la IA está relacionado con la expansión de los modelos de lenguaje grande (LLM) y modelos multimodales (LMM), que requieren un intenso proceso de entrenamiento e inferencia.

La creación de modelos como Chat GPT ha implicado emisiones significativas, con la generación de 552 toneladas de CO2 y un consumo de hasta 700 mil litros de agua dulce, solo para entrenar el modelo.

Este tipo de procesos incrementa no solo las emisiones de CO2, sino también el consumo de recursos como el agua, destacando la huella hídrica de empresas tecnológicas. Además, una sola consulta en plataformas como ChatGPT puede consumir hasta 500 ml de agua, lo que demuestra el impacto indirecto pero importante de la IA en los recursos naturales.

Según Arrow el agua se utiliza principalmente en sistemas de enfriamiento a nivel de subsistema y de sistema, debido a su alta eficiencia en la transferencia de calor.

En el enfriamiento a nivel de subsistema, el agua circula a través de unidades de distribución de enfriamiento (CDU) para refrigerar los dispositivos individuales, y en el nivel de sistema, se emplea en sistemas enfriados por agua, conocidos como sistemas hidrónicos, para manejar grandes cargas térmicas en centros de datos de alta demanda.

Desigualdad de acceso y sus implicaciones

Finalmente, la IA puede acentuar las desigualdades sociales existentes, ya que no todas las personas tienen acceso a las mismas herramientas o formación para utilizarla.

ISDI México alerta sobre la brecha digital que podría ampliarse aún más con la implementación de tecnologías avanzadas. En muchas regiones, especialmente en América Latina, el costo de acceso a la tecnología y la falta de formación especializada dificultan la incorporación de muchos sectores de la población a este nuevo paradigma digital.

Esto podría perpetuar la desigualdad social, ya que aquellos con acceso a estas tecnologías estarán mejor posicionados para aprovechar sus beneficios, mientras que aquellos sin acceso podrían quedar marginados.

La inteligencia artificial, sin duda, es una herramienta poderosa que promete transformar el mundo en múltiples aspectos. Sin embargo, como hemos visto, sus desventajas y peligros son considerables y deben ser tratados con seriedad.

Desde el desplazamiento de empleos hasta los riesgos para la privacidad y la discriminación algorítmica, es fundamental que se establezcan regulaciones claras y que las empresas, gobiernos y ciudadanos trabajen para mitigar estos riesgos.

Solo con una implementación ética y responsable podremos asegurar que la IA se utilice de manera que beneficie a toda la sociedad, sin comprometer los valores fundamentales que nos hacen humanos.

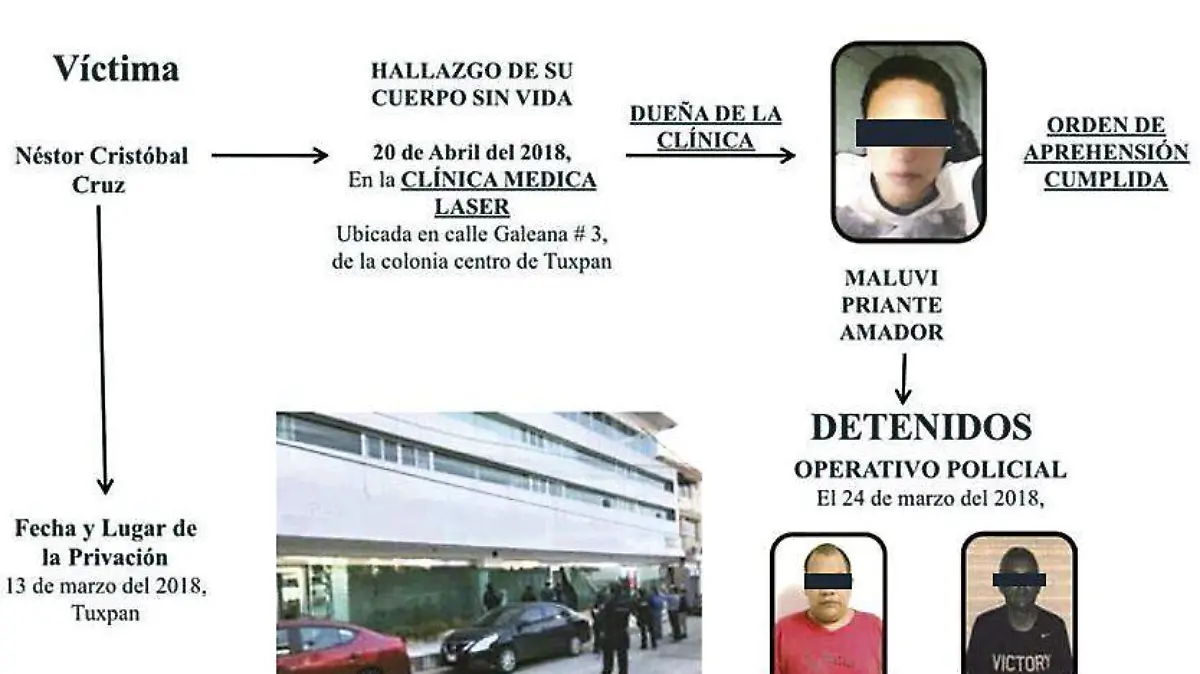

Sentencian a tercer implicado en caso “Clínica del Terror”

La Fiscalía General del Estado a través de la Unidad Especializada en Combate al Secuestro, logró sentencia condenatoria de 80 años de prisión en contra de Omar "N" como responsable del delito de secuestro agravado, cometido en agravio de Néstor Cristobal Cruz.

El juez además de dictar sentencia, estableció un pago por concepto de reparación del daño y suspendió sus derechos civiles y políticos, dentro del juicio oral 9/2018.

Estos hechos, ocurrieron el pasado 13 de marzo de 2018, cuando la víctima, de oficio taxista, salió de su domicilio ubicado en la colonia Ruiz Cortines de este municipio para cubrir un servicio; posteriormente, los secuestradores exigieron un pago de rescate por su liberación.

Sin embargo, el 20 de abril del mismo año, su cuerpo fue hallado al interior de la entonces Clínica Medical Laser, durante un cateo de más de 8 horas en las instalaciones ubicadas en la calle Galeana casi esquina Avenida Juárez de la colonia Centro.

Posteriormente y a través de un comunicado, el Gobierno del Estado confirmó la detención de Omar "N" así como de Vito "N" y Maluvi "N" encargada de la clínica, destacándose que en 2022 estos dos últimos recibieron una sentencia de 65 años de prisión por el delito de Secuestro Agravado.

20 Frentes Fríos han cruzado Veracruz; temporada próxima a finalizar

Continúa la temporada de frentes fríos 2024-2025; en promedio 50 frentes arriban al país al año, de ellos 30 cruzan por el estado de Veracruz y este año el Servicio Meteorológico Nacional pronosticó la llegada de 48 al territorio nacional.

Hasta esta fecha se contabilizan 37, de los cuales 20 cruzaron el Estado de Veracruz y para abril se esperan cuatro frentes, al momento ya se registra uno. La temporada de frentes fríos concluye el próximo 15 de mayo.

En cuanto a los escenarios para el bimestre abril-mayo en Veracruz, se espera un ambiente ligeramente más caluroso de lo normal con lluvia acumulada menor o igual al promedio.

De acuerdo a la Subdirección de Estudios y Pronósticos Meteorológicos de la Secretaría de Protección Civil Veracruz, la conclusión del fenómeno de La Niña está próximo, para dar paso a una fase neutra , sin El Niño y sin la Niña, durante este mes de abril y probablemente persistir hasta el verano con una probabilidad del 65 por ciento.

En tal situación, los pronósticos de largo plazo pueden tener más variaciones entre una actualización y otra.